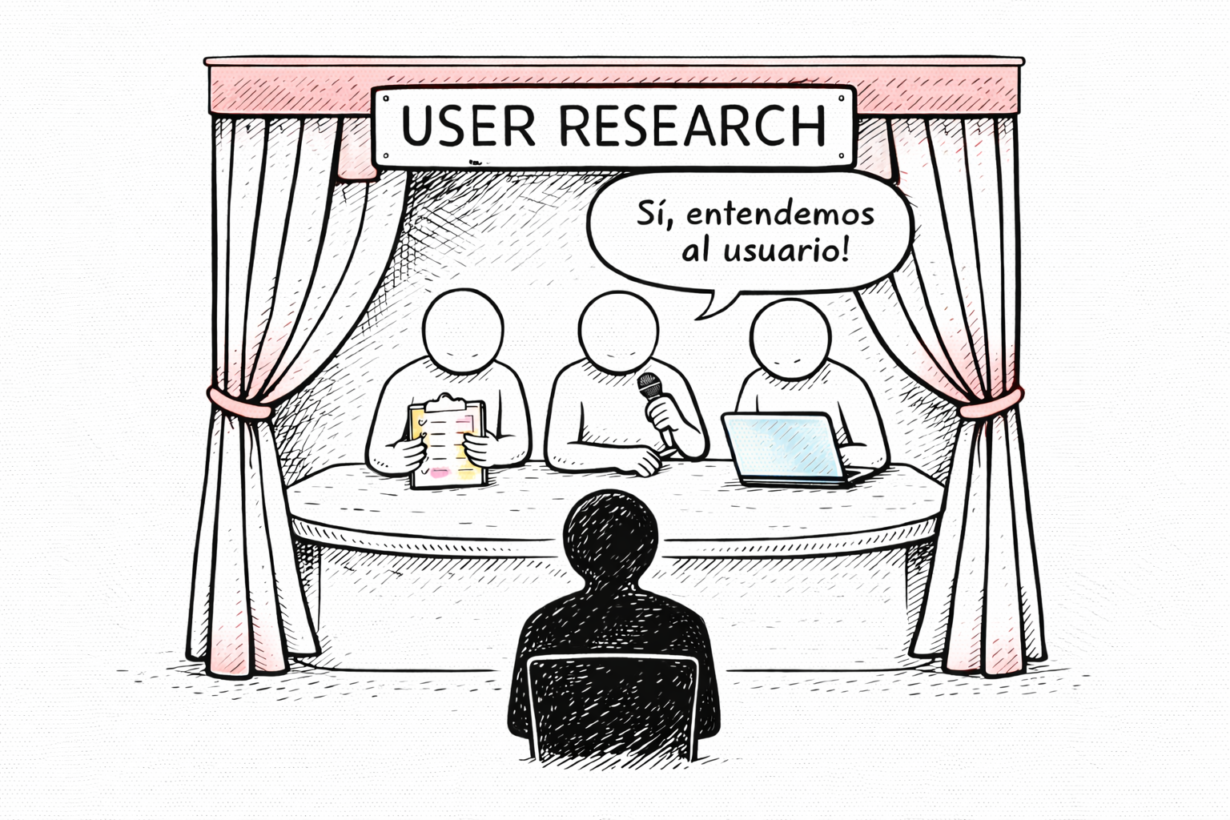

Hay una frase que los equipos dicen como si fuera un seguro contra incendios:

—“Tranquilos: entendemos al usuario.”

La dicen justo antes de hacer lo contrario.

Se arma research cuando la decisión ya está tomada. Se entrevista gente para confirmar una intuición que ya tiene presupuesto. Se pegan quotes en una slide para que la roadmap parezca humana. Y en algún momento, alguien pronuncia la oración final, esa que cierra cualquier discusión:

—“Esto lo validamos con usuarios.”

Ese es el maquillaje: usar al usuario como argumento de autoridad. No para aprender. Para blindarse.

La escena es conocida. Y no porque estén mintiendo en técnica —a veces las entrevistas ocurrieron, los tests existen, los números están— sino porque están mintiendo en intención: no están buscando entender. Están buscando permiso.

La pregunta que casi nadie quiere hacer en voz alta, porque suena antipática y porque arruina el clima del sprint, es esta:

¿Estamos intentando entender a las personas… o estamos fabricando evidencia para seguir igual?

La mentira más rentable: “hicimos research”

En los equipos sanos, investigar es reducir incertidumbre.

En los equipos apurados, investigar es reducir culpa.

La versión apurada tiene un patrón casi coreografiado:

- alguien con poder define el rumbo,

- el equipo arma “investigación” para apoyar ese rumbo,

- se presenta como evidencia,

- se cierra la conversación.

A eso se le empezó a llamar research theatre: la apariencia de investigación por encima de la sustancia. No es un insulto al método. Es un diagnóstico del sistema: cuando el objetivo es justificar, la investigación se vuelve utilería.

Y acá hay un test brutalmente simple: si antes de hablar con una sola persona ya sabés qué decisión no se puede mover, entonces no estás investigando. Estás documentando.

Documentar no está mal. Lo que está mal es venderlo como “entender usuarios”.

Mini-caso: “solo queremos reducir fricción”

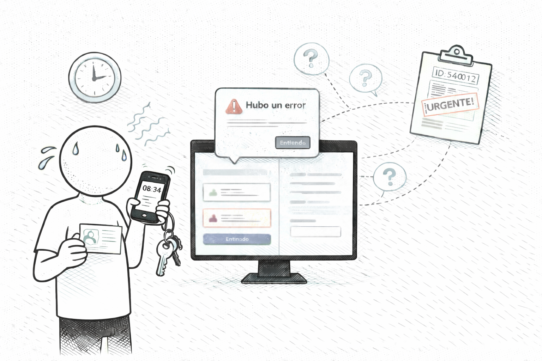

Una fintech (llamémosla Faro) tenía un problema “simple”: mucha gente abandonaba el alta en el paso de verificación de identidad.

En la daily, alguien lo dijo como si fuera algo técnico, casi higiénico:

—“Esto es fricción. Hay que simplificar.”

—“¿Y si sacamos el paso?”

—“Compliance no deja.”

—“Entonces hagamos que parezca más simple.”

Se armó un sprint de “UX improvements”. Hubo tests rápidos. Hubo quotes listos para slide:

—“Me da paja subir fotos.”

—“No entiendo por qué lo piden.”

Y con eso, el equipo concluyó: el usuario quiere menos pasos.

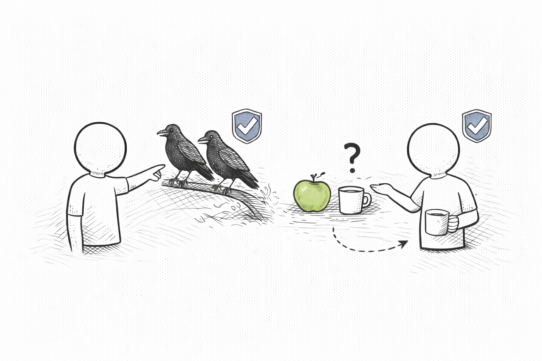

Lo que no preguntaron (porque no querían escuchar) fue otra cosa: qué miedo vive debajo de esa paja. Miedo a que le roben datos, a quedar expuesto, a que el sistema lo acuse, a que soporte no responda. Miedo a perder control.

Entonces hicieron lo que hacen muchos equipos cuando no pueden eliminar el requisito: lo ocultaron con microcopy amable y UI “amigable”.

El resultado fue raro: bajó un poco el abandono inmediato, pero subieron reclamos, dudas, tickets y desconfianza. No era fricción. Era confianza.

Y la confianza no se “reduce”. La confianza se construye con claridad, control y consecuencias explícitas.

Cuando “experiencia” significa “comportamiento inducido”

Acá conviene decirlo sin perfume: una parte grande de la industria habla de UX mientras implementa patrones manipulativos.

No hace falta paranoia. Hay evidencia y hay regulación moviéndose.

La FTC (EE.UU.) publicó un informe de “dark patterns” donde describe prácticas que inducen creencias falsas o empujan a decisiones no intencionadas: suscripciones difíciles de cancelar, disclosures enterradas, confirmshaming, interfaces que traban la salida.

Y hay evidencia a escala: el estudio Dark Patterns at Scale (CSCW / Princeton y colaboradores) analizó decenas de miles de páginas de producto en miles de sitios y encontró miles de instancias de patrones engañosos, además de terceros que los ofrecen “como servicio”.

También hay una foto global que da vergüenza: una revisión internacional coordinada por redes de protección al consumidor (ICPEN) encontró que la mayoría de sitios y apps revisados usaban al menos un dark pattern en suscripciones (y muchos usaban varios).

El problema no es solo “que existan”. Es el lenguaje con el que se justifican:

—“Los usuarios prefieren…”

—“Es para que entiendan…”

—“Es por la experiencia…”

No. Es por conversión.

Y ahí la investigación se puede volver la coartada perfecta: en vez de testear comprensión o confianza, se testea si la gente cae o no cae. Se mide “funciona”. Y si funciona, se escala.

Ese es el punto donde “entender usuarios” deja de ser investigación y pasa a ser ingeniería de consentimiento.

El giro: entender usuarios no es amar gente, es asumir consecuencias

Hay una idea que ayuda a sacarse el maquillaje: diseñar no es empatizar. Diseñar es elegir.

Y elegir siempre deja a alguien afuera.

Por eso me sirve una mirada como Design Justice: no se queda en “hagamos research con más diversidad”, sino que pregunta quién define el problema, quién tiene poder en el proceso, quién asume los costos y quién se beneficia.

Volvamos a Faro. El problema nunca fue “paja de subir fotos”. El problema era que el sistema pedía un acto de vulnerabilidad (identidad) sin devolver control equivalente (claridad, garantías, salida).

La corrección real no era “hacerlo más fácil”. Era hacerlo más honesto:

- “Te pedimos esto por X razón.”

- “Esto guardamos y por cuánto tiempo.”

- “Esto NO hacemos.”

- “Esto pasa si no lo completás.”

- “Esto podés hacer si preferís otro canal.”

La gente tolera fricción cuando entiende el trato. Lo que no tolera es el truco.

Un botón puede delatarte

Imaginá un paywall con prueba gratis.

Opción A: “Empezar prueba gratis”

(en letra chica: “Se cobrará automáticamente al finalizar”)

Opción B: “Probar gratis 7 días (luego $X/mes)”

Subtexto: “Te avisamos 24 h antes. Cancelás en 2 taps.”

La diferencia no es copy. Es intención. En A, el modelo depende de que alguien no se dé cuenta. En B, depende de que alguien elija.

Y si pensás que esto es exageración, mirá el mundo real: en 2024 la FTC anunció la regla de “click-to-cancel” para que cancelar sea tan fácil como suscribirse (al menos en intención regulatoria), y luego hubo litigios y bloqueos en cortes federales. El punto no es el chisme legal: el punto es que si hay que legislar “que cancelar sea fácil”, es porque a demasiadas empresas les conviene que no lo sea.

El error típico del equipo (y por qué ocurre)

Error: tratar al usuario como evidencia selectiva.

Se ve así: el equipo busca “insights” que calcen con la estrategia ya decidida. Si aparecen señales en contra, se etiquetan como outliers, “usuarios raros” o “casos extremos”.

¿Por qué ocurre?

- Porque admitir que el usuario te contradice te obliga a renegociar poder interno.

- Porque los tiempos de delivery castigan la duda.

- Porque el research se volvió un artefacto de legitimación, no un motor de decisión.

- Porque “centrado en el usuario” es fácil de decir y difícil de pagar.

Y sí: “pagar” es la palabra. Porque entender usuarios, de verdad, cuesta. No por presupuesto. Por renuncias.

La parte que nadie quiere aceptar: no alcanza con “mejor UX”

Algunas prácticas no se arreglan con un better flow. Se arreglan con límites.

La OECD lo plantea sin romanticismo: estos patrones “oscuros” (o “dark commercial patterns”) explotan sesgos y empujan decisiones que no van en el interés del consumidor. Y discute evidencia de prevalencia, efectividad y daño, además de respuestas de política pública.

En 2025, por ejemplo, organizaciones de consumidores en Europa presentaron una queja contra Shein por el uso de dark patterns para empujar sobreconsumo (timers, low-stock, confirmshaming, etc.). Otra vez: no es “un caso suelto”, es una señal de época: se acabó la paciencia con el “crecimiento” basado en empujar sin consentimiento claro.

Lo que me interesa de esto no es el titular. Es el espejo: muchos equipos juran que no hacen “eso”, pero después implementan versiones pequeñas del mismo mecanismo, solo que con mejor tipografía.

Cierre: la pregunta que te conviene llevar a la próxima reunión

La próxima vez que alguien diga “necesitamos entender al usuario”, no respondas con un método. Respondé con una condición.

“¿Qué decisión estás dispuesto a cambiar si lo que aprendemos te contradice?”

Si la respuesta es “ninguna”, no vas a empezar research. Vas a empezar teatro.

Y el teatro es caro.

No por el presupuesto.

Por el tipo de producto que terminás construyendo cuando convertís a las personas en utilería.

Fuentes

- FTC — Bringing Dark Patterns to Light (Staff Report, 2022).

- Mathur et al. — Dark Patterns at Scale: Findings from a Crawl of 11K Shopping Websites (CSCW 2019 / Princeton).

- ICPEN — Resultados del “sweep” global sobre dark patterns en suscripciones (2024).

- Heylighen & Dong — To empathise or not to empathise? Empathy and its limits in design (Design Studies, 2019).

- OECD — Dark Commercial Patterns (reporte y materiales relacionados).

- Costanza-Chock — Design Justice (MIT Press, acceso abierto).

- BEUC — Queja contra Shein por dark patterns y sobreconsumo (2025).

Interpretación del autor

El problema con “entender usuarios” no suele ser falta de empatía ni de método. Es falta de disposición a pagar el costo político de lo aprendido. Si el research no puede cambiar decisiones, solo va a producir mejores historias para justificar lo mismo. Y cuando el usuario se vuelve coartada, el diseño deja de ser una disciplina de criterio y se convierte en una disciplina de maquillaje.